变压器工厂干冒烟了,但谁在买单?

2026 年初,AI 圈最火的词不是某个新模型,而是**“OpenClaw(龙虾)”**。这个让全球打工人集体“养虾”的代理人框架,标志着 AI 正式从“对话框”走进“操作系统”。

然而,当你感叹 OpenClaw 帮你处理邮件、操作电脑的神奇时,背后却是一场残酷的**“硅片战争”**。36Kr 最近揭示了一个令人震惊的事实:那个曾经只买芯片不卖芯片的谷歌,正带着它的 TPU 大军,拆掉英伟达 75% 毛利率的围墙。

1. TPU 的“刺客式”进攻:性价比才是硬道理

过去我们迷信英伟达,是因为 CUDA 牢不可破。但在 2026 年,算力已经成了**“大宗商品”**。

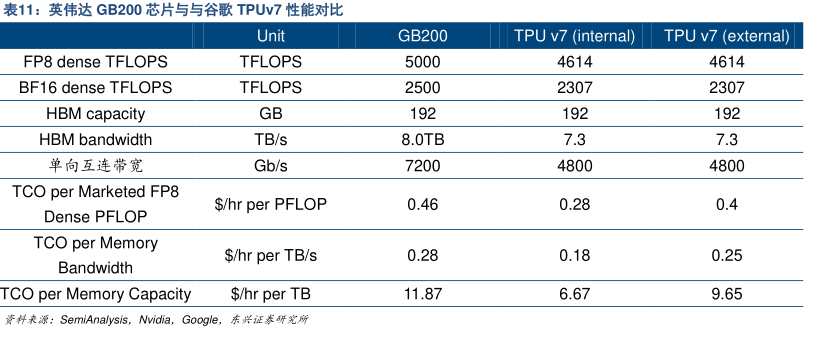

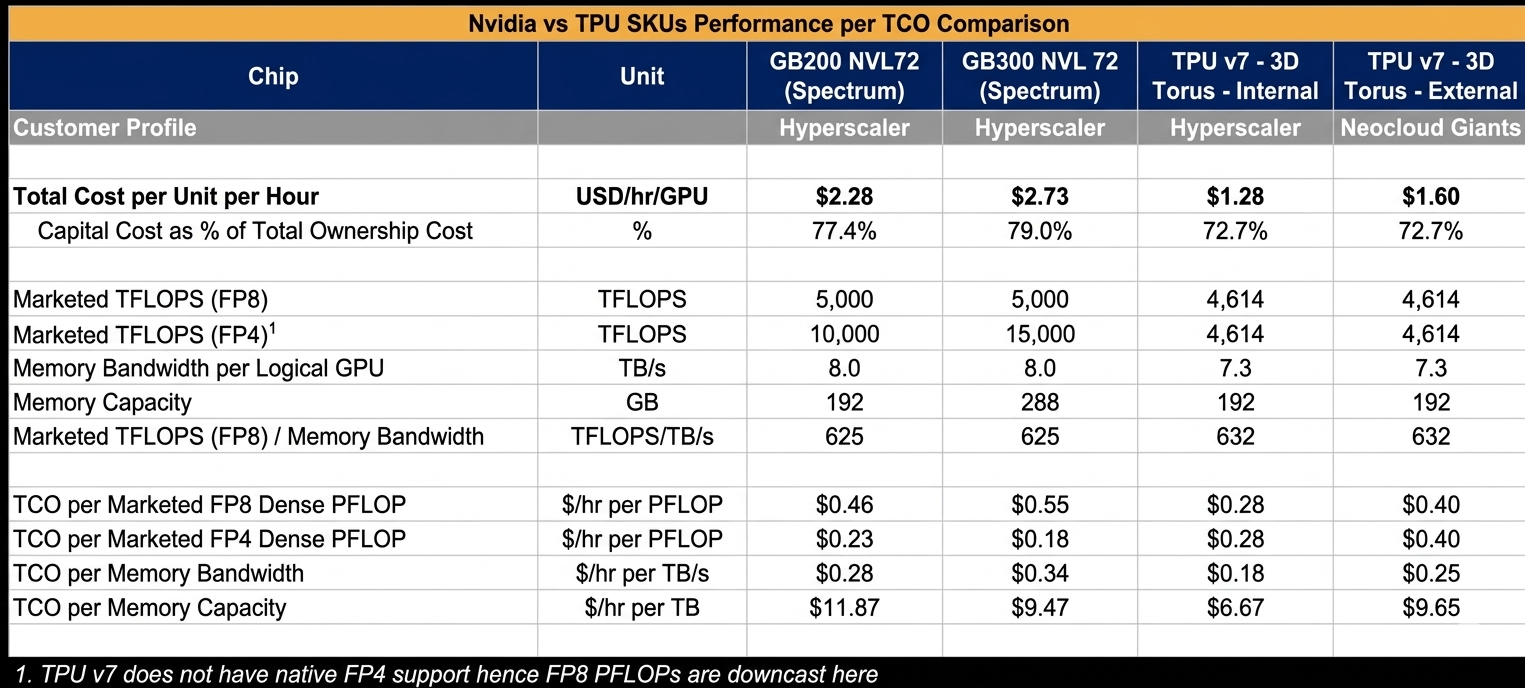

根据 SemiAnalysis 的测算,TPUv7 (Ironwood) 的总拥有成本比英伟达的黑盒(Blackwell)低了整整 44%。这意味着,如果你是一个开发者,想部署一套支持万级 OpenClaw 运行的后台,选择谷歌阵营能让你直接省出一半的硬件钱。

更“狠”的是,谷歌不再端着架子。它通过一种**“混合销售”**模式,直接把芯片卖给 Anthropic,甚至通过金融杠杆帮初创公司担保。OpenAI 甚至仅仅通过“威胁要买 TPU”,就让英伟达乖乖降价了 30%。

2. 为什么你的“龙虾”需要谷歌的“核心”?

为什么 OpenClaw 的爆发与谷歌的发展方向高度契合?

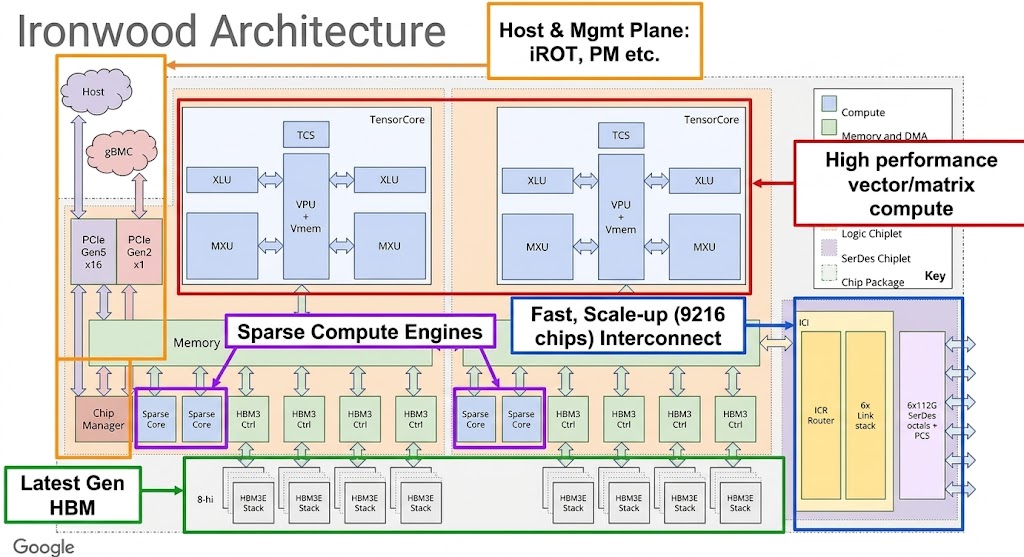

光互连与毫秒级重构:OpenClaw 这种 AI Agent 需要极高的响应速度。谷歌自研的 OCS 光交换机 能在毫秒级绕过故障点。这意味着当你的“龙虾”在帮你处理紧急跨国合同方案时,底层算力几乎不会因为硬件抖动而掉链子。

生态的“倒戈”:过去用 TPU 难,是因为要学 JAX。现在谷歌彻底认输——全面拥抱 PyTorch。这意味着你写的 OpenClaw 插件,可以无缝在 TPU 和 GPU 之间切换。护城河不再是软件,而是谁的机房电费更低、散热更好。

3. 2026 展望:谷歌的“反围剿”与个人算力自由

结合 Google 2026 年的发展方向,我们能看到三个趋势:

算力普惠化:随着 TPUv8 的曝光,单卡算力将不再是瓶颈。对于像 fucoreai.com(硅基核心) 这样的硬核读者来说,未来“千元级 V100 服务器”可能会进化为“二手 TPU 算力模组”,普通人也能在家养老外挂级的 AI 代理。

AGENT FIRST 硬件:谷歌未来的芯片设计将更侧重于 推理(Inference) 而非仅仅是训练。因为 2026 年是“应用元年”,全球有数亿只“龙虾”在跑,低延迟、低功耗的推理芯片才是真正的利润中心。

金融与算力的深度捆绑:谷歌正在把自己变成一家“算力银行”。它用信用担保连接电力方和开发者,这为 OpenClaw 生态提供了稳定的底座。

结语:行动起来,活在当下

在 ASI(人工超智能)的奇点时刻,英伟达和谷歌的王者之争对我们普通人意味着什么?

答案是:算力平权。 当巨头们开始打价格战,当 TPU 填平了 CUDA 的沟壑,对于开发者和极客来说,那是最好的时代。别再犹豫你的服务器是用 3090 还是 V100 了,紧跟 Google 的系统工程思维,养好你的 OpenClaw,因为真正的核心,永远是那个能让技术落地、为人类干活的“硅基心脏”。

评论区